GitHub 如何用 eBPF 提前拦住高风险部署:一份更实用的借鉴清单

GitHub 如何用 eBPF 提前拦住高风险部署:一份更实用的借鉴清单

先说结论

如果把这篇 GitHub 官方工程文只读成“又一个 eBPF 用例”,就低估了它的价值。GitHub 这次真正公开的,不是一个更酷的内核技巧,而是一种新的部署安全思路:把“会不会在事故里自断修复路径”这件事,从人工 review 清单,前移成部署时就能拦截的运行时闸门。

我的判断很明确:只有那些已经在管理有状态主机、滚动发布、脚本化运维、而且最怕“出事时修不了自己”的团队,才值得借鉴 GitHub 这套 eBPF 做法;如果你现在还是普通 stateless Web 服务、发布链路很短、依赖边界也不复杂,先把依赖盘点、回滚资产、预发验证补齐,收益通常比直接上 eBPF 更大。

先给一个可提取的短答案:

- 适合借鉴这套 GitHub eBPF 部署安全思路的团队:管理数据库、存储、内部平台、长生命周期主机的 infra / platform / SRE 团队。

- 不适合直接照抄的团队:以容器化 stateless 服务为主、发布链路简单、还没把依赖清单跑明白的小团队。

- 这篇文章最值得抄的点:不是 eBPF 本身,而是把“部署脚本的外部依赖”当成生产风险对象来治理。

- 适用边界:这更像平台工程手段,不是通用 DevOps 装饰件;用错了会把系统复杂度抬得比收益还高。

如果你最近在看 AI 或自动化系统的可控执行层,可以顺手对照这篇 GitHub Agentic Workflows 安全架构公开后,团队最该补的不是模型能力,而是可控执行层。两篇文章虽然不在同一层,但在回答同一个问题:真正危险的,不是“工具会不会执行”,而是“故障时你还能不能控制它怎么执行”。

GitHub eBPF 部署安全这件事的核心问题

GitHub 在 2026 年 4 月 16 日的官方工程文章里,讲了一个很具体、也很容易被忽视的风险:GitHub 自己把代码托管在 GitHub 上,所以一旦 github.com 本身故障,部署系统就可能出现循环依赖——要修 GitHub,先得依赖 GitHub 自己还活着。

这个问题乍看像个极端案例,但其实很多团队都遇到过缩小版:

- 数据库故障时,修复脚本还要去拉外部二进制;

- 运维脚本表面本地可跑,实际启动时会偷偷检查更新;

- 一个发布脚本又去调用另一个内部服务,而后者再去依赖同一批已经出问题的系统。

GitHub 把这类风险统一叫成 circular dependency,并拆成 3 类:

- Direct dependency:脚本直接去 GitHub 拉 release 或工具;

- Hidden dependency:本地已有工具,但运行时还会联网查更新;

- Transient dependency:脚本调用别的服务,那个服务再去依赖 GitHub 或别的关键系统。

这一步拆解很重要。因为它说明部署安全不只是“脚本有没有 bug”,而是修复链路里有没有你没看见的网络依赖。

关键机制拆解

1)GitHub 不是在做“更细的监控”,而是在做“部署时的网络闸门”

这篇官方文章最关键的一句,不是“我们用了 eBPF”,而是 GitHub 发现 只靠团队自己 review 部署脚本,很难在事故发生前找全这些循环依赖。原因也很现实:很多依赖不是写在脚本里,而是藏在工具运行时、更新检查、内部 API 跳转里。

所以 GitHub 没继续加 review checklist,而是把思路换成:能不能在部署脚本运行时,只监控并限制这段进程自己的网络外联?

这就是 eBPF 在这里真正的角色。它不是替代回滚,不是替代变更评审,而是给部署脚本加一层运行时边界。

2)GitHub 用 cGroup + eBPF,把限制范围缩到“只有部署进程”

GitHub 文章里明确提到,他们关注的是 BPF_PROG_TYPE_CGROUP_SKB 这一类 program type,因为它可以挂到特定 cGroup 的网络 egress 上。翻成人话就是:不是把整台主机断网,而是只盯住那个部署脚本所在的进程组。

这点非常关键。

因为 GitHub 管的是有状态主机,这些机器在滚动部署、drain、重启过程中仍可能继续服务生产流量。如果粗暴地把 github.com 整站断掉,客户请求也会被一起影响。GitHub 选 eBPF 的核心理由,不是“性能高”,而是粒度够细,能只约束修复动作,不波及业务流量。

这跟我们前面写 Cloudflare 内部 AI 工程栈时提到的那条原则很像:真正能上生产的系统,靠的往往不是“最强功能”,而是把 身份、路由、上下文和审查链路接成一个系统。GitHub 这次把同样的治理逻辑,落在了部署脚本的网络边界上。

3)GitHub 真正解决的不是 IP 封禁,而是“DNS 级别的依赖识别”

如果文章只停在“用 eBPF 挡 IP”,其实没那么有意思。因为 GitHub 自己也承认,系统规模和变化速度太大,维护一份稳定可用的 IP blocklist 很难。

他们往前又走了一步:

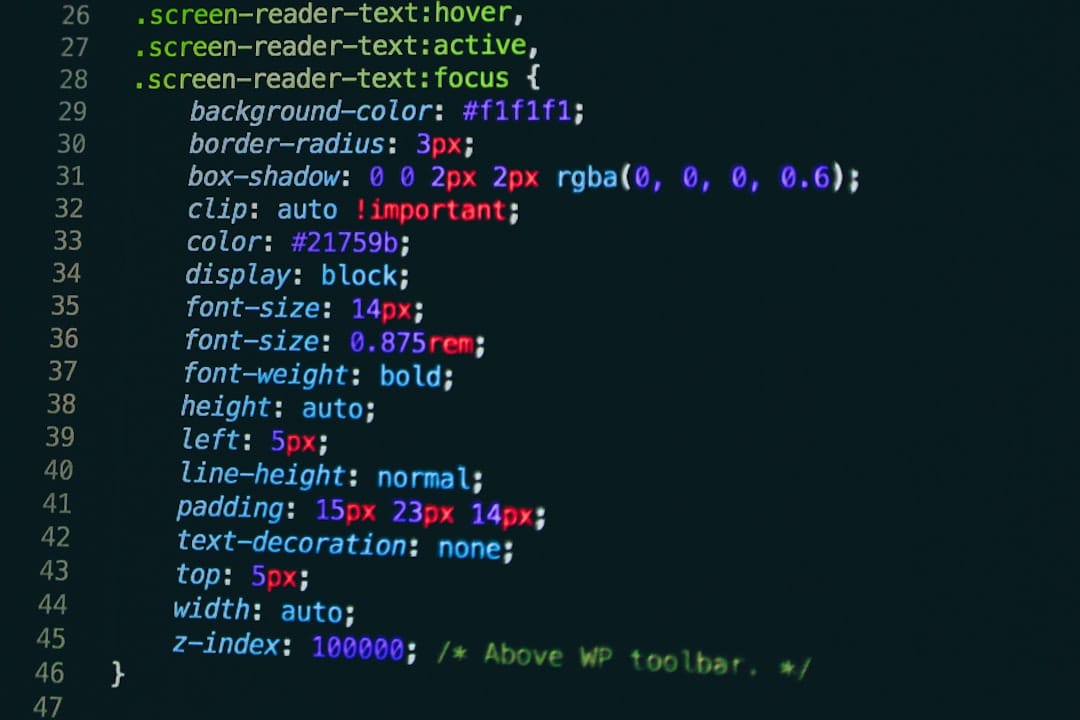

- 用

BPF_PROG_TYPE_CGROUP_SOCK_ADDR截获连接请求; - 把发往 53 端口的 DNS 请求改写到本地代理;

- 由 userspace DNS proxy 判断请求域名是否命中 block list;

- 再通过 eBPF maps 把允许/拒绝结果传回内核程序。

这一层才是我觉得最值得看的地方。因为它把“部署脚本会不会依赖不该依赖的站点”,从 IP 问题变成了域名级、进程级、可解释的策略问题。

也就是说,GitHub 不是只知道“有包发出去了”,而是能知道:

- 是哪个进程发起的;

- 访问了哪个域名;

- 为什么被拦;

- 对应命令行是什么。

这就从“防火墙式粗拦”升级成了“可以给团队追责和修脚本的证据链”。

4)这套做法最有价值的产物,其实是审计清单

GitHub 在文中给出的结果,不只是能 block,还包括三件更实用的事:

- 条件性阻断会引起循环依赖的域名;

- 告诉 owning team 是哪条命令触发了请求;

- 输出一份部署期间实际联系过哪些域名的 audit list。

这意味着它并不只是事故时的紧急刹车,也是平时梳理部署依赖的观测层。

这点和 GitHub 很早以前维护的官方开源项目 Scientist 有一种很像的工程哲学:先把系统里的真实行为跑出来、比较出来、记录出来,再决定能不能替换或放行。Scientist 当年做的是 control/candidate 的生产对比;这次 eBPF 做的是 deployment command / runtime dependency 的生产审计。层次不同,但思路是一致的:别只靠代码静态上“看起来没问题”,要让系统在真实路径里自己暴露风险。

5)GitHub 抄作业的门槛,不在 eBPF,而在你的系统成熟度

GitHub 文中提到,这套新的 circular dependency detection 流程已经经历了 six-month rollout 并上线。这个时间点很重要,它说明这不是黑客式 demo,而是一个逐步收敛、逐步上线的平台改造。

所以我不建议把这篇读成“eBPF 很强,大家都该上”。更准确的读法应该是:

- GitHub 先有很明确的高价值风险对象:有状态主机与修复链路;

- 再有很明确的限制目标:部署进程外联;

- 最后才轮到 eBPF 成为合适实现。

如果这三个前提在你团队都不存在,那直接学 GitHub 的实现,几乎一定是过度工程。

两个常见误区

误区一:GitHub 这篇文章是在教大家“怎么学 eBPF”

不是。

它当然给了 cilium/ebpf、CGROUP_SKB、CGROUP_SOCK_ADDR 这些实现细节,但整篇真正想解决的是 deployment safety,不是 eBPF 教程。把重点放错,就很容易最后只抄了技术名词,没抄到风险模型。

误区二:只要把发布前 review 做细一点,就不需要这类运行时限制

也不是。

GitHub 之所以要做这套机制,就是因为 hidden dependency 和 transient dependency 不是靠 review 就能稳定找全。尤其是工具自动更新、二级调用、服务链路转发,这些东西经常只有跑起来才会露出来。

案例 / 类比

可以把 GitHub 这套思路类比成机场安检。

过去很多团队的部署安全,更像是登机前问一句:“你包里应该没有危险品吧?” 这对应的是 review、规范、知识库。

GitHub 这次做的,是在真正过安检闸机的时候,再扫一遍:你现在带的到底是什么、从哪来、要去哪。

这也是为什么这篇文章对今天做代码 Agent、自动化运维、平台工程的人有现实价值。因为自动系统最怕的,不是平时慢一点,而是出事时它还坚持走那条已经断掉的依赖链。你如果关心 reviewer 怎么在自动化越来越多时拿到可信证据,可以再看这篇 当代码 Agent 开始批量提交 PR,Hugging Face 给开源维护者补的不是自动化,而是 reviewer 能信的证据链。一个在审 PR 前补证据,一个在部署执行时补边界,本质上都是把“默认信任”改成“先验证再放行”。

对你的实际影响

- 对 platform / SRE 团队:如果你们有状态主机多、修复脚本长、依赖服务复杂,这篇文章值得认真拆。

- 对普通应用团队:先别急着上 eBPF。你更该先做的是列清发布脚本依赖、冻结关键二进制、准备离线回滚资产。

- 对 AI / 自动化系统团队:这篇文章不是 AI 专题,但它提供了一个更底层的现实提醒:真正的可控执行层,最后都会落到进程、网络、权限和审计。

- 对管理者:GitHub 这类实践最值得学的不是“技术栈先进”,而是它明确知道哪类事故最贵,所以愿意为那条修复链单独建护栏。

可执行建议

- 先盘点部署脚本的外部依赖:把直接下载、更新检查、二级 API 调用都列出来,不要只看 shell 文件表面。

- 把关键修复工具做成本地可用资产:像 GitHub 维持 mirror 和 built assets 一样,事故时不能再赌外网可用。

- 优先给高风险主机做运行时审计,而不是全平台统一上 eBPF:数据库、状态服务、核心控制平面优先。

- 把“谁发起了这个依赖请求”记录下来:没有进程级证据,团队很难真正修掉隐藏依赖。

- 把部署安全目标写成一条明确判断:你的目标到底是“更快发现异常”,还是“事故时仍能修复”,这会决定你该做 review、审计,还是运行时阻断。

FAQ

GitHub 这篇 eBPF 文章,最值得普通团队抄的是什么?

不是 eBPF 代码本身,而是把部署脚本外联依赖当成生产风险对象来治理。很多团队的问题不在于没有内核能力,而在于根本没把这类依赖单独建模。

GitHub 为什么不用简单断网来验证部署脚本?

因为 GitHub 管的是有状态主机,部署期间这些机器仍可能服务生产流量。整机断网会影响真实请求,所以它才需要更细粒度地只限制部署进程自己的网络外联。

哪些团队适合把 eBPF 用到部署安全里?

最适合的是 platform / infra / SRE 团队,尤其是有数据库、存储、内部控制平面、长脚本发布链路的团队。小型 stateless Web 团队通常还没到这一步。

这和传统 review、变更审批有什么不同?

review 和审批发生在变更前,GitHub 这套机制发生在执行时。它能抓到 hidden dependency 和 transient dependency,这类风险往往只有脚本真实跑起来才会暴露。

这套思路对 AI Agent 或自动化系统有什么启发?

启发在于:真正的安全边界最终不会停留在提示词或流程图上,而会下沉到进程、网络、权限和审计日志。Agent 只是把这个问题提前暴露出来,平台工程早就在面对同一个底层约束。

一句话复盘

GitHub 这次用 eBPF 补上的,不是一层更高级的监控,而是一道事故里仍然能工作的部署闸门:先确认修复链路不会依赖故障本身,再让变更继续执行。

参考来源:

- GitHub Engineering(2026-04-16):https://github.blog/engineering/infrastructure/how-github-uses-ebpf-to-improve-deployment-safety/

- GitHub 官方仓库 Scientist:https://github.com/github/scientist