开发者工具

Hugging Face Docker Space 能跑 Arm64 吗?先查这 3 个兼容性卡点

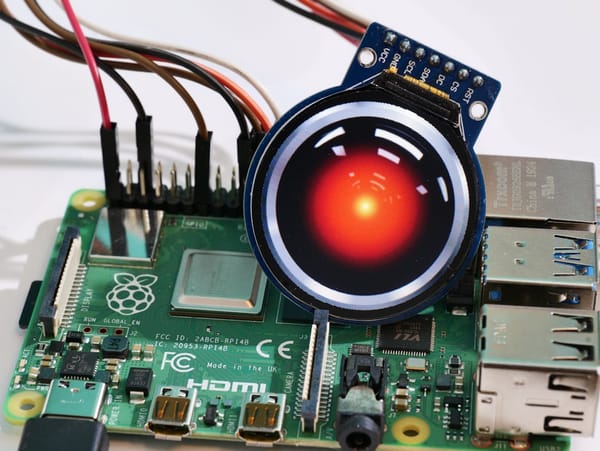

Hugging Face Docker Space 能跑 Arm64 吗?先查这 3 个兼容性卡点 Article type: tutorial Voice: reviewer 如果你打算把一个 Hugging Face Docker Space 部署到 Apple Silicon、Jetson,或者后面准备迁到 Graviton 这类 Arm64 环境,最省时间的做法不是先把镜像拉下来硬跑一遍,而是先做 3 个检查:基础镜像有没有 arm64 manifest、依赖里有没有写死 x86_64 wheel、仓库里有没有把平台假设藏在 requirements 或启动脚本里。 这篇文章的短答案是:能不能跑,不取决于它是不是 Hugging Face Docker Space,