谷歌Nano-Banana模型引领创意革命:从2D插画到3D手办的热门玩法

2025年的AI领域,一股全新的热潮正在席卷全球创意社区。谷歌最新推出的图像生成模型Nano-Banana

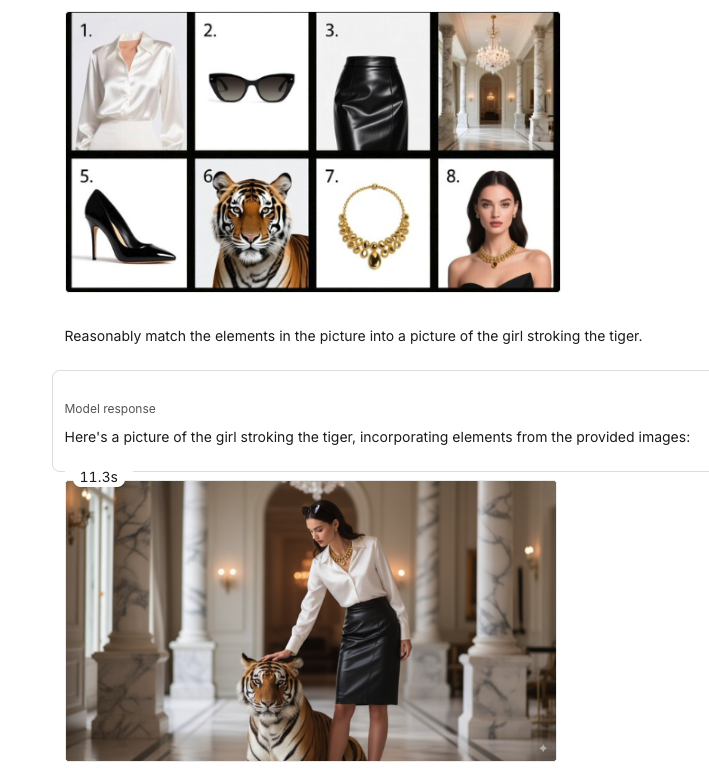

在2025年的AI领域,一股全新的热潮正在席卷全球创意社区。谷歌最新推出的图像生成模型Nano-Banana,以其惊人的编辑和生成能力,成为无数设计师、艺术家和手办爱好者的新宠。这个模型不仅能通过简单文字提示实现图像的精细调整,还能将平面插画转化为具有深度感和多视角的3D效果,从而直接助力制作实体手办。近期,这一玩法在社交媒体和科技论坛上刷屏,吸引了大量用户分享他们的创作过程。根据最新报道,这一模型的推出标志着AI在图像处理领域的重大突破,让普通人也能轻松实现从概念到实物的转变。 本文将深入探讨这一热门玩法,结合实时检索到的信息,提供详细指导和案例分析,帮助你快速上手。

Nano-Banana模型的诞生与核心功能

谷歌Nano-Banana模型,其实是Gemini 2.5 Flash Image的昵称,这个名字源于其在AI竞技场LMArena上的匿名测试阶段,当时以“nano banana”身份亮相,并迅速登顶排行榜。 于2025年8月正式发布后,它立即成为科技新闻的焦点。不同于传统的图像编辑工具,这个模型强调自然语言交互,用户只需描述想要的变化,就能实现复杂的编辑操作。

模型的核心优势

首先,Nano-Banana在图像编辑上的表现堪称革命性。它支持通过文字提示对现有图像进行修改,例如移除背景、添加元素或调整光影,而无需专业软件技能。 例如,你可以上传一张插画,然后输入“将背景替换为森林,并添加柔和的阳光”,模型能在几秒内生成结果。更重要的是,它在保持对象一致性方面表现出色,能确保人物或物体在多次编辑中不变形,这对于创建系列图像至关重要。

其次,速度是其一大亮点。相比其他AI工具需要10-15秒的处理时间,Nano-Banana往往只需1-2秒就能输出高质量图像。 这让它特别适合实时迭代创作,尤其在手办设计中,用户可以快速测试不同角度和变体。

最后,虽然主要定位于2D图像,但Nano-Banana支持新型视图合成(novel view synthesis),这意味着它能从单一2D图像生成多个视角的变体,从而模拟3D效果。 这正是将插画转化为3D手办的关键技术基础。通过生成前后左右等多个一致性视图,用户可以轻松构建3D模型的基础数据。

模型的访问方式

目前,Nano-Banana集成在谷歌的Gemini应用中,用户可以通过Gemini app、Adobe Express或其他支持平台免费试用。 一些第三方平台如Bylo.ai也提供了免费在线演示版本,支持直接上传图像进行转换。 对于开发者,还可以通过API集成,实现更高级的自动化流程。 不过,由于刚发布,访问可能受限于地区或账户类型,建议用户检查最新更新。

从2D插画到3D手办的完整转化流程

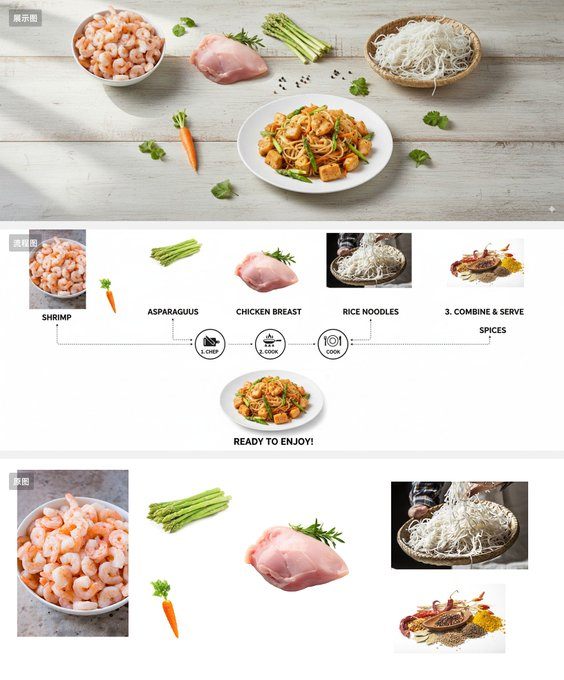

这一玩法的核心在于利用Nano-Banana的图像生成能力,结合3D建模和打印技术,实现从平面到立体的跃迁。近期,许多教程视频和博客分享了详细步骤,证明这一方法简单高效,甚至适合初学者。 下面,我们分解整个过程,确保每一步都基于实时资讯。

准备阶段:选择和优化插画

首先,选择一张高质量的2D插画作为起点。插画应有清晰的轮廓和细节,便于AI识别。推荐使用数字绘画软件如Procreate或Photoshop创建原创插画,或从免费资源库下载。

接下来,上传到Nano-Banana平台。打开Gemini app,进入图像编辑模式,输入提示如“优化这张插画的细节,使其适合3D转换”。模型会自动增强分辨率和一致性。 如果使用Bylo.ai,选择“Nano Banana AI Image Generator”,上传文件后开始编辑。

生成多视角图像

这是转化的关键步骤。Nano-Banana的novel view synthesis功能允许从单一图像生成不同角度的视图。 输入提示如“从正面、侧面、背面和顶部生成这个插画的视图,保持一致的深度和光影”。

具体操作:

- 上传原始插画。

- 输入文字提示指定角度,例如“旋转45度,添加真实光影”。

- 生成4-8个视图,确保每个视图的视角、照明和透视一致。

这一步通常只需几分钟,模型会自动处理深度估算,使图像看起来像从3D模型渲染而出。 用户反馈显示,Nano-Banana在这一领域的准确率远超竞争对手,如Flux AI。

构建3D模型

有了多视角图像后,转入3D建模软件。推荐免费工具如Blender或Meshroom,它们支持从图像重建3D网格。

步骤:

- 导入生成的视图图像到Blender的Image as Planes功能。

- 使用Photogrammetry插件(如Colmap)对图像进行对齐和重建,生成初步3D网格。

- 手动优化模型:添加纹理、调整比例,确保手办的比例合适(通常10-20cm高)。

- 如果需要更高级效果,使用Sculpt模式雕刻细节。

一些教程建议结合其他AI工具,如Stable Diffusion辅助纹理生成,但Nano-Banana的核心作用在于提供一致的基础视图。

3D打印与后处理

最后,将3D模型导出为STL格式,上传到3D打印服务如Shapeways或本地打印机。选择材料如树脂或PLA,确保打印精度高。

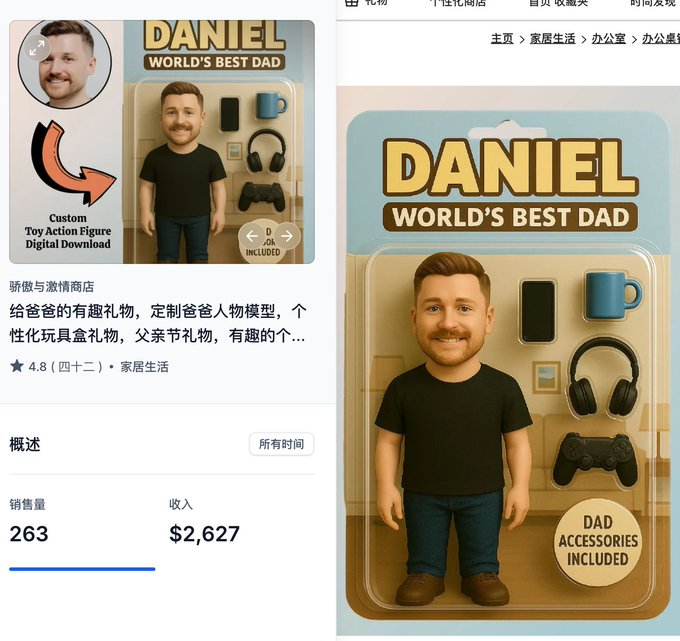

后处理包括打磨、上色和组装。许多用户分享,使用Nano-Banana生成的图像作为参考,能让手办颜色更贴合原插画。 整个过程从插画到成品可能只需几天,成本控制在50-200美元。

实际案例与用户分享

这一玩法已在社区中爆火。举例来说,一位TikTok用户上传了将动漫角色插画转为手办的过程,使用Nano-Banana生成视图后,在Blender中建模,最终打印出精致模型,获赞数万。

另一个案例来自建筑设计师,他们用Nano-Banana将手绘草图转为3D建筑模型,加速原型制作。 在游戏开发中,开发者利用它创建一致的角色变体,节省了手动建模时间。

Reddit论坛上,用户讨论Nano-Banana是“最一致的模型”,特别在动画工作流中,将单张图像转为完整序列。 一篇Medium文章详细记录了如何用它创建个性化头像手办,从上传自拍到最终打印。

这些案例证明,这一玩法不限于专业人士,普通爱好者也能参与。近期YouTube教程视频播放量飙升,如一则“50+ Nano-Banana使用方式”视频,展示了从插画到手办的多种变体。

潜在挑战与优化技巧

尽管强大,Nano-Banana并非完美。早期用户报告偶尔出现随机扭曲或提示误解。 为避免,建议使用精确提示,如指定“保持原比例,无变形”。

另一个挑战是3D重建的准确性。如果视图不一致,可能导致模型扭曲。技巧:生成更多视图(至少8个),并在Blender中手动校正。

版权问题也需注意。使用原创插画,避免侵权。社区建议结合开源模型增强效果。

优化提示:利用Nano-Banana的多图像融合功能,先创建变体,再合成最佳视图。 对于手办爱好者,加入“可爱风格”或“现实主义”提示,能提升最终效果。

未来展望与行业影响

Nano-Banana的推出预示着AI在创意领域的更大潜力。谷歌表示,未来将扩展到视频编辑和更高级3D生成。 这可能让手办制作从手工转向AI辅助,降低门槛。

在行业中,它挑战了OpenAI等对手,推动图像AI向更精细方向发展。 对于手办市场,这一玩法或催生新创业,如定制服务。

总体而言,这一热潮正重塑创意流程。无论你是艺术家还是粉丝,都值得一试。跟随最新更新,探索无限可能。