OpenAI Privacy Filter 适不适合拿来做脱敏 Web 应用?我实测后给出的判断

OpenAI Privacy Filter 适不适合拿来做脱敏 Web 应用?我实测后给出的判断

Article type: take

我先说结论:如果你要做的是文档高亮审阅、截图脱敏,或者“把一段敏感文本变成可分享的脱敏版本”这类入口,OpenAI Privacy Filter 已经值得拿来做原型;但如果你要的是可审计、字段级强约束、对中文或行业术语有稳定召回的生产脱敏链路,先别把它当成“一接就上”的成品。

这里说的 OpenAI Privacy Filter,当前准确指的是 Hugging Face Hub 上的 openai/privacy-filter 模型卡 和围绕它做的公开 demo,不是一个“在 OpenAI 控制台里点一下就开的 API 开关”。这个命名边界要先讲清,否则后面的部署、成本和数据路径都会判断错。

我这轮没有只看发布文。我直接调用了 Hugging Face 官方文章《How to build scalable web apps with OpenAI's Privacy Filter》里提供的 SmartRedact Paste 公开 Space:把一段包含姓名、邮箱、手机号和账号号的英文样例送进去后,接口返回了 view_path、reveal_path、分类统计,以及一段已经打码的文本;有用的地方是分享链路已经成型,值得拿来做产品原型,别忽略的地方是默认占位符在这次输出里出现了重复拼接,说明你上线前仍要补一层结果后处理。

本文的证据范围也先说清:判断主要基于 openai/privacy-filter 模型卡、Hugging Face 官方应用文章,以及这次对公开 Space 的最小实测;它不是一篇完整 benchmark,也不构成对中文召回率、行业术语、人名变体效果的生产背书。

一个最小判断清单

如果你现在就在判断要不要试它,先看这 4 条:

- 适合试:你要处理的是长文本或上传文件里的 PII,而不是几个固定字段的表单校验。

- 适合试:你愿意先从 review-in-the-loop 流程开始,让人先看高亮、遮罩和统计,再决定是否自动放行。

- 先别直接上生产:你需要稳定的中文命名实体效果、严苛合规审计,或必须完全自控推理链路。

- 先别偷懒:即使用公开 demo 跑通了,也要自己补后处理、阈值、误报抽检和日志策略。

这次题材为什么值得写,不只是“又一个 PII 模型发布”

Hugging Face 这篇官方文章给的不是空泛性能介绍,而是 3 个已经能直接打开的应用形态:

- 文档审阅:

Document Privacy Explorer - 图片打码:

Image Anonymizer - 文本分享:

SmartRedact Paste

这比单独一张 model card 更有运营价值,因为它直接把问题从“模型准不准”推进到了“入口值不值得做成产品”。如果你最近在看浏览器端 AI 工具怎么落地,可以顺手对照我们前面写过的这篇 Transformers.js Chrome 扩展实践:那篇的核心摩擦是首下体积、MV3 分工和权限;而 OpenAI Privacy Filter 这条线的核心摩擦,已经开始从“模型能不能跑”转向“哪种脱敏入口最适合先做成完整体验”。

我实际跑了一次:最先暴露出来的不是模型能力,而是结果后处理

这次我直接调用了 SmartRedact Paste 的公开 Gradio API,输入的是一段带有姓名、邮箱、电话和账号号的测试文本。返回结果里有几项值得单独记:

- 返回了

view_path和reveal_path,说明它不是只做分类,还把“分享脱敏文本 / 私下保留明文入口”这件事一起产品化了。 stats里给了total_spans、pii_percentage和各类别计数,适合直接挂到前端侧边栏或审核后台。- 这次输出里,

<PRIVATE_PERSON>、<PRIVATE_EMAIL>、<PRIVATE_PHONE>、<ACCOUNT_NUMBER>都出现了重复拼接,不是一类“看起来很严重但其实无关”的小瑕疵,而是一个明确提醒:你不能把默认 redacted 字符串原样当生产输出,需要自己补 span merge、占位符去重或模板化替换。

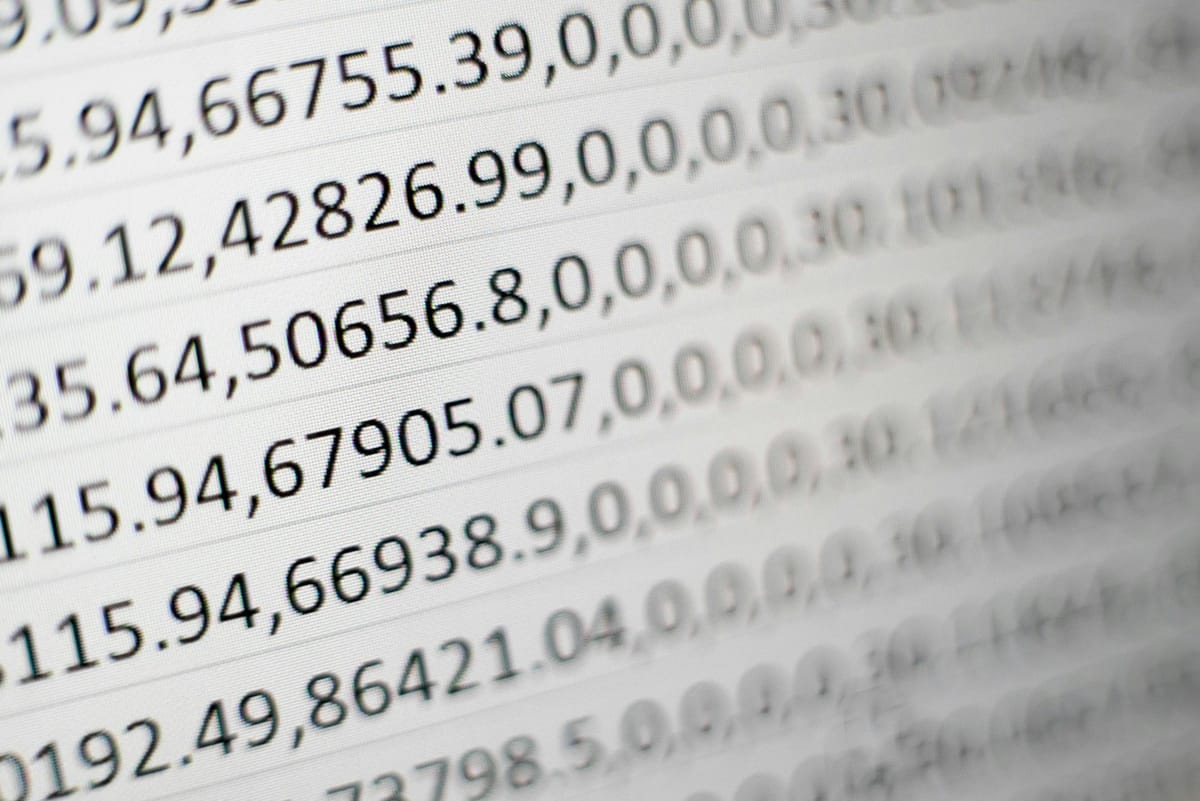

我这次拿到的一小段关键返回结果大致是这样:

{

"stats": {

"total_spans": 8,

"pii_percentage": 54.5

},

"redacted": "<PRIVATE_PERSON><PRIVATE_PERSON> can be reached at <PRIVATE_EMAIL><PRIVATE_EMAIL> ..."

}

我用的最小验证方式如下:

import json, urllib.request

host = "https://ysharma-opf-smartredact-paste.hf.space"

payload = {

"data": [

"Alice Smith can be reached at [email protected] or +1 415-555-0199. Her account number is 1234567890.",

"24h"

]

}

req = urllib.request.Request(

host + "/gradio_api/call/create_paste",

data=json.dumps(payload).encode(),

headers={"Content-Type": "application/json", "User-Agent": "Mozilla/5.0"},

)

验收时我主要看 3 个点:

- 能不能返回可分享的脱敏链接,而不只是模型 logits

- 统计信息是不是足够支撑人工复核

- 脱敏后的文本是否还需要产品层再清洗一次

这和我们之前写过的 Hugging Face Docker Space Arm64 兼容性排查 其实是同一类判断:先别急着问“能不能上”,先问最小可复现路径有没有暴露出真正的上线门槛。

OpenAI Privacy Filter 目前最适合先做成哪 3 类 Web 应用

1)长文档审阅,而不是简单字段遮罩

这是它当前最自然的入口。

Hugging Face 官方文章里最有说服力的一点,不是“模型有 128k context”,而是他们把这个能力放进了一个可阅读的文档审阅器:上传 PDF 或 DOCX 后,直接在原文阅读流里高亮不同类别的 PII,而不是拆成一堆表单字段让你逐项核对。

这类场景适合它,是因为长文档里的问题通常不是“有没有邮箱字段”,而是“这整份文件里哪些地方该被人工再看一眼”。如果你在做知识库入库、客服质检、合同外发前检查,OpenAI Privacy Filter 更像一个高亮器 + 风险预筛器,而不是最终裁决器。

2)截图和图像脱敏,但最好保留人工改动环节

官方 demo 里的 Image Anonymizer 不是只把 OCR 做出来再自动盖黑条,而是把结果放到一个可编辑画布里,让人继续补标或修正。这个产品决定很对。

因为图片里的脱敏,从来不只是“识别到没识别到”这么简单。UI 截图里经常混着昵称、订单号、头像旁边的备注、页面结构线索,纯自动红线很容易误判。你如果真要把它接进客服后台、工单系统或 bug 回报流程,保留人工二次确认比追求全自动更实际。

3)分享型文本脱敏,这是最容易先做出业务价值的一档

这次最让我觉得“可以先做产品”的,其实是 SmartRedact Paste。因为它解决的不是单纯识别,而是一个具体动作:

- 我有一段要发给别人看的文本

- 里面有敏感信息

- 我想公开分享脱敏版,自己保留可回看的明文入口

这在客服协作、外包沟通、社区提问、bug 复现、法务初筛里都很常见。对很多团队来说,先做分享型脱敏比先做“全量数据自动清洗平台”更容易拿到真实使用量。

如果你接下来还要把脱敏后的内容喂给 agent 或知识库,再回看这篇 OpenAI Agents SDK 边界梳理 会更有帮助:先把“进入 agent 之前的隐私处理层”独立出来,通常比把所有责任都塞进 agent 本身更稳。

适合谁 / 不适合谁

适合谁

- 在做文档审阅、工单系统、客服后台、知识库预处理的团队

- 需要先做 demo、想尽快验证“脱敏入口本身有没有人用”的产品团队

- 愿意接受 human-in-the-loop,而不是一上来就追求全自动脱敏闭环的场景

不适合谁

- 需要固定字段、强规则、强审计的合规系统

- 主要处理中文、本地地址、人名变体、行业缩写,且没有额外微调预算的团队

- 对数据路径非常敏感,当前又不准备把模型和服务全链路自托管的团队

真正该先补的,不是“再找一个 demo”,而是这 5 个生产前检查

如果你准备把 OpenAI Privacy Filter 从 demo 往前推一步,我建议先过这 5 个门槛:

- 结果后处理:做一次 span merge、占位符去重和类别映射,不要直接输出 demo 的 redacted 文本。

- 抽样复核:每类 PII 先抽几十条人工复核,尤其看误报和漏报会不会集中在同一种文本结构上。

- 数据路径:明确哪些流量能走公开 Space,哪些必须改成自托管。

- 交互设计:优先保留高亮、遮罩、侧边栏统计、可回看明文这类解释层,而不是只给“通过 / 拒绝”。

- 回退方案:模型不稳定时,至少能退回规则模板、人工审核或只做提示不自动替换。

FAQ

OpenAI Privacy Filter 是 OpenAI API 里的官方能力吗?

不是当前这篇文章讨论的这个形态。这里说的是 Hugging Face Hub 上的 openai/privacy-filter 模型,以及围绕它做的公开 demo 和 Space。

OpenAI Privacy Filter 适合直接处理中文内容吗?

这次我没有做中文专项评测,所以不能给宽泛肯定。按目前公开材料和这轮最小实测,更稳妥的说法是:先把它当英文或通用 PII 原型工具,再自己做中文样本抽检。

OpenAI Privacy Filter 和传统正则脱敏,谁更适合先上?

如果你的输入结构很固定,比如手机号、身份证号、固定表单字段,传统规则往往更便宜、更可解释。OpenAI Privacy Filter 更适合的是长文本、非结构化内容,以及你不想把所有检测逻辑手写一遍的场景。

OpenAI Privacy Filter 能不能直接给 agent 工作流做前置清洗?

可以当候选前置层,但不要直接把 demo 结果原样塞进去。至少先补后处理、抽检和失败回退,再决定是否放进 agent 或检索链路。

OpenAI Privacy Filter 现在最值得先做哪种 MVP?

优先级我会排成:分享型脱敏文本 > 文档审阅器 > 图片打码。因为分享型文本最容易把“识别 + 脱敏 + 链接交付”闭成一个真实工作流。

结论

OpenAI Privacy Filter 现在最值得关注的,不是“OpenAI 又发了一个隐私模型”,而是它已经被包装成了几种很具体的 Web 应用入口:文档审阅、图像打码、分享型脱敏文本。

如果你正在评估 OpenAI Privacy Filter,要先问的不是“能不能上生产”,而是:你的第一步到底是在做识别模型评测,还是在做一个有人真的会用的脱敏入口。 从这轮实测看,后者已经有试做价值;但生产化之前,结果后处理、人工复核和数据路径,还是得你自己补齐。