Hugging Face Docker Space 能跑 Arm64 吗?先查这 3 个兼容性卡点

Hugging Face Docker Space 能跑 Arm64 吗?先查这 3 个兼容性卡点

Article type: tutorial

Voice: reviewer

如果你打算把一个 Hugging Face Docker Space 部署到 Apple Silicon、Jetson,或者后面准备迁到 Graviton 这类 Arm64 环境,最省时间的做法不是先把镜像拉下来硬跑一遍,而是先做 3 个检查:基础镜像有没有 arm64 manifest、依赖里有没有写死 x86_64 wheel、仓库里有没有把平台假设藏在 requirements 或启动脚本里。

这篇文章的短答案是:能不能跑,不取决于它是不是 Hugging Face Docker Space,而取决于基础镜像、wheel 和安装脚本有没有一起覆盖 Arm64。 以本文引用的 ACE-Step v1.5 案例和这轮复现结果看,基础镜像本身可用,但依赖链默认锁在 linux/amd64,所以会在安装阶段先出问题。

先说明一个容易混淆的名字:本文里的 Hugging Face Docker Space,特指 Hugging Face Spaces 里的 Docker Space 项目,不是泛指所有 Hugging Face Spaces,也不是泛指所有 Hugging Face 模型仓库。对这类项目,真正决定你能不能跑在 Arm64 上的,往往是容器和依赖栈,而不是模型卡片本身。

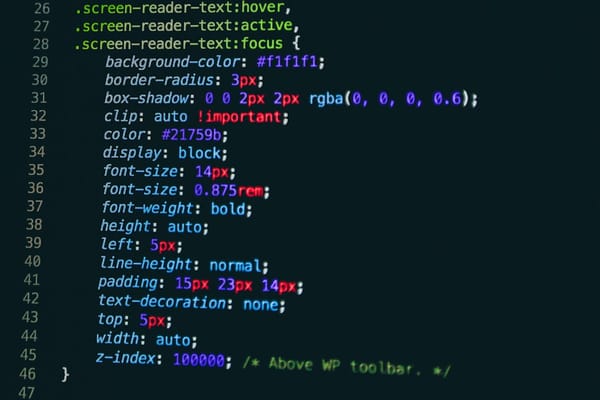

验证摘要(2026-04-23,示例复现环境:Apple Silicon)

docker manifest inspect python:3.11-slim:可见linux/amd64与linux/arm64/v8,说明基础镜像本身支持 Arm64。/opt/anaconda3/bin/python -m pip download --platform manylinux2014_aarch64 --only-binary=:all: --python-version 311 'flash-attn @ https://github.com/mjun0812/flash-attention-prebuild-wheels/releases/download/v0.7.12/flash_attn-2.8.3+cu128torch2.10-cp311-cp311-linux_x86_64.whl':返回is not a supported wheel on this platform,说明依赖 URL 已经把平台锁死在 x86_64。- 结论:在本文引用的案例里,Arm64 风险点不在

FROM,而在 wheel 和安装链路。

先看结论:什么团队适合先做这套检查

适合谁

- 要把 Hugging Face Space 从 demo 搬到本地开发机的团队

- 计划把推理或服务迁到 Apple Silicon、Jetson、Graviton 这类 Arm64 环境的人

- 想在采购边缘硬件前,先判断项目有没有明显平台锁定问题的团队

不适合谁

- 你只打算继续用 Hugging Face 官方托管环境,不会自己构建镜像

- 你的目标项目根本不是 Docker Space,而是纯 Gradio / 静态前端页

- 你现在只想看模型效果,不打算接手构建、依赖和部署

为什么这个问题现在值得先查

Docker 在 2026 年 4 月的一篇官方文章里,用 ACE-Step v1.5 这个 Hugging Face Space 作为案例,给出的核心判断不是“Arm64 不行”,而是很多项目失败点根本不在 Dockerfile 主体,而在某个写死平台的依赖 URL。文中还提到,这是他们在当时分析 Hugging Face Docker Spaces 时观察到的高频问题;这属于当时点的官方观察,不是平台永久事实。

按这轮复现环境看:ACE-Step v1.5 卡点不在基础镜像

这轮没有直接复刻完整 Space 构建,而是先核最关键的三个点。

1)基础镜像本身并不堵 Arm64

ACE-Step v1.5 的 Dockerfile 直接写的是 FROM python:3.11-slim。按上面的 manifest 检查结果,这个基础镜像同时提供 linux/amd64 和 linux/arm64/v8。换句话说,第一层门并没有关上。

这点很重要,因为它把问题范围一下缩小了:如果基础镜像有 arm64,后面再挂,大概率就不是“Docker 完全不支持”,而是项目自己的依赖链有平台假设。

2)真正的硬锁在 requirements.txt

这个 Space 的 requirements.txt 里有一行:

flash-attn @ https://github.com/mjun0812/flash-attention-prebuild-wheels/releases/download/v0.7.12/flash_attn-2.8.3+cu128torch2.10-cp311-cp311-linux_x86_64.whl ; sys_platform == 'linux' and python_version == '3.11'

关键不在 flash-attn 这四个字,而在 URL 末尾那个 linux_x86_64.whl。这等于把 wheel 平台提前写死了。

按上面的 pip 下载命令复现,返回的是 is not a supported wheel on this platform。这不是“推测它会挂”,而是依赖本身已经把平台写进文件名了。

3)所以这类项目常见的风险是:表面上基础镜像跨平台,但实际依赖链只在 x86 路径上验证过

Dockerfile、Python 版本、主依赖名都可能让你误以为“应该能跑”。真正的问题往往躲在:

- 平台限定 wheel URL

- 某些 CUDA / Triton 依赖默认按 x86 路径拼装

- requirements 没写死平台条件,但 release 产物本身没有 arm64 wheel

这也是为什么更建议你先做结构化检查,而不是先猛拉镜像:很多时候,浪费时间的不是最终跑不起来,而是你太晚才发现问题其实藏在依赖声明里。

Hugging Face Docker Space Arm64 检查清单

如果你只想先做一轮发布前判断,按下面顺序就够了。

第一步:确认它是不是 Docker Space

先看仓库或 Space 页面,确认它是不是基于 Docker SDK。不是 Docker Space 的项目,这套检查会失焦。

可直接用这几个信号排:

- Space 页面是否能看到

Dockerfile - 仓库根目录是否有

Dockerfile - README 或配置里是否明确写了 Docker SDK / Docker Space

预检查:先扫仓库里的平台锁定信号

如果你已经把仓库拉到本地,可以先跑一遍:

grep -RniE 'x86_64|amd64|manylinux|flash-attn|triton|cu11|cu12' .

这一步不是为了下最终结论,而是先快速定位最可能卡住 Arm64 的依赖、wheel 和 CUDA 路径。

第二步:查基础镜像有没有 arm64 manifest

重点不是版本新不新,而是你依赖的基础镜像有没有 linux/arm64。如果这里就没有,后面基本不用继续。

通用检查命令:

docker manifest inspect python:3.11-slim

如果你装了 jq,可以再把平台信息单独拉出来:

docker manifest inspect python:3.11-slim | jq '.manifests[].platform'

第三步:扫 requirements / pyproject / install 脚本

优先找这几类信号:

- URL 里直接出现

x86_64、amd64 - 只提供某个平台 wheel 的 GitHub release 链接

flash-attn、Triton、CUDA 相关包被写成固定下载地址- shell 脚本里手动拼平台名

如果你已经定位到具体 wheel URL,可以直接把它拿去做最小化验证。把下面命令里的链接替换成目标项目自己的 wheel 即可:

/opt/anaconda3/bin/python -m pip download --platform manylinux2014_aarch64 --only-binary=:all: --python-version 311 'flash-attn @ https://github.com/mjun0812/flash-attention-prebuild-wheels/releases/download/v0.7.12/flash_attn-2.8.3+cu128torch2.10-cp311-cp311-linux_x86_64.whl'

第四步:把“构建失败”拆成哪一层失败

最少要区分清楚:

- 镜像拉不下来:通常是 manifest 问题

- 镜像能拉、pip 装挂:通常是 wheel / 依赖问题

- 依赖能装、运行时报错:通常才轮到 runtime 或内核兼容问题

第五步:再决定值不值得继续移植

如果问题只是单个 wheel URL 写死,通常还有改造空间;如果核心依赖链从头到尾都围着 x86 + CUDA 架设,那就别把它包装成“很快能迁”的项目。

什么时候值得继续,什么时候应该先停

可以继续推进的情况

- 基础镜像已有 arm64 manifest

- 阻塞点集中在 1-2 个平台限定依赖

- 维护者社区里已经有人提过类似 issue 或 PR

- 你的目标是本地开发验证,而不是马上上生产

应该先停一下的情况

- 核心依赖链直接绑定 x86/CUDA 预编译产物

- 项目文档完全没有提平台支持范围

- 你需要的是稳定生产服务,而不是“先试试看”

- 你没有余力维护私有 patch 或替代 wheel

常见误区

误区 1:Apple Silicon 能跑很多容器,所以这个项目大概率也行

错。Apple Silicon 只能说明你的机器是 Arm64,不代表上层 Python wheel、CUDA 依赖、第三方 release 也给 Arm64 准备好了。

误区 2:Dockerfile 很普通,就说明可移植性没问题

也错。很多项目挂掉不是挂在 FROM,而是挂在最不显眼的那一行依赖声明。

延伸阅读

如果你还在补这类发布前验证能力,可以顺手看三类站内内容:

- 开发者工具栏目:适合继续看 CLI、构建链和工程侧检查方法。

- 开源精选栏目:适合继续看开源项目在真实交付里的兼容性与维护问题。

- Hugging Face 给 reviewer 补证据链:适合对照看“看起来能跑”和“已经验证能跑”之间差在哪。

FAQ

Hugging Face Space 只要用了 Docker 就能跑 Arm64 吗?

不能。Docker 只解决容器打包和分发,不自动替你修好平台限定 wheel。

怎么最快判断一个 Space 有没有 x86 锁定?

先看 requirements.txt、pyproject.toml、安装脚本里有没有 x86_64、amd64、固定 wheel 下载链接。这比直接开跑更省时间。

基础镜像支持 arm64,是不是就说明项目没问题?

不是。基础镜像只说明第一层兼容,项目依赖照样可能在安装阶段失败。

这种问题更适合个人开发者还是团队先查?

两边都适合,但团队更该前置做,因为它直接影响采购、迁移路径和后续维护成本。

结论:Hugging Face Docker Space 的 Arm64 兼容,先查依赖,再谈部署

如果你问的是 “某个 Hugging Face Docker Space 能不能跑在 Arm64”,最可靠的答案不是一概而论的能或不能,而是先检查基础镜像、依赖 wheel 和平台假设这 3 层。以这次 ACE-Step v1.5 的案例和复现结果看,基础镜像并没有先把门关上,真正先出问题的是默认锁在 x86_64 的依赖链。

对个人开发者,这能省掉一轮无效折腾;对团队,这能把“要不要继续迁移”从感觉题变成检查题。

来源

- Docker Blog: How to Analyze Hugging Face for Arm64 Readiness

- Hugging Face Space: ACE-Step v1.5

- ACE-Step v1.5 源文件:

Dockerfile/requirements.txt